ChatGPTって? 生成AIの基本とその可能性を探る!テクニカルレポート

公開日:2025年4月22日

R&D本部言語処理技術部 シニアITアーキテクトの林です。

ChatGPTをはじめとする生成系大規模言語モデル(生成AI)は、ビジネスや教育、クリエイティブ分野をはじめ、私たちの生活のさまざまな場面で活用されています。こうした技術の進化に伴い、生成AIの仕組みや活用方法に関する正しい理解が求められるようになりました。

そこで今回は、生成AIの基本的な技術情報をわかりやすく解説し、みなさんが生成AIとともによりよい未来を築いていくためのヒントを提供します。

生成AIが生み出す新たな可能性を、一緒に探求していきましょう。

ChatGPTの登場により急速に進化した生成AI

2022年11月にOpenAI社がChatGPTを発表して以来、生成AIは驚異的なスピードで世間に広まりました。しかし、その開発は突然はじまったわけではありません。

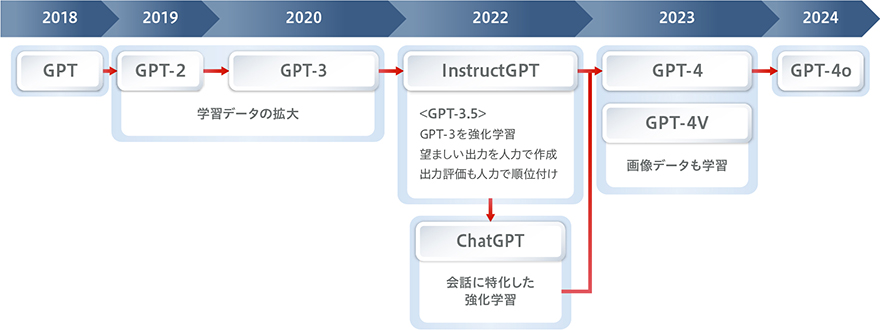

OpenAIは2018年6月に最初のGPTを発表し、その後も改良を続けました。2020年5月には、5000億語に相当する膨大なテキストで学習したGPT-3をリリース。さらに、2022年1月にはInstructGPT(GPT-3.5)が登場し、「人手を使った強化学習(Reinforcement Learning from Human Feedback:RLHF)」を導入することで、より利用者の意図に沿った回答や文章を生成することが可能になりました。

現在のChatGPTは、このInstructGPTをもとに「会話」に特化した学習を施したモデルです。基本的な人間のコミュニケーションである「会話」機能を持ったことが一気に普及したいちばんの要因といえます。その後も進化を続け、2023年3月に発表されたGPT-4では画像などの多様な情報を処理する機能(マルチモーダル機能)が追加され、GPT-4V、GPT-4oへと発展しています。

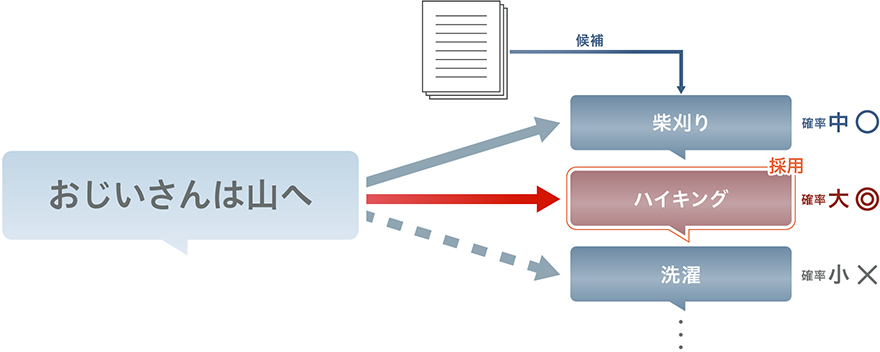

ChatGPTなどのGPT系の生成AIは、「次の言葉を予測する」仕組みで文章をつくります。たとえば、「おじいさんは山へ……」のあとに続く言葉を、「柴刈り」「ハイキング」「山菜取り」などの候補から確率に基づいて選びます。

この予測を正確にするために、生成AIは大量の文章を学習し、単語の頻度や組み合わせなどからより正確に次の言葉を予測します。その結果、生成AIが言葉の使い方を学習して、翻訳、要約、文章作成など幅広い分野で活用されています。

さらに、生成AIは事前に学習したモデルだけで、さまざまな課題にも対応することを目標としています。そのため、ゼロショット性能(事前を与えなくても、適切に答えられる能力)が高いという特徴もあります。

生成AIが持つ4つの特徴とは?

ChatGPT以降の生成AIには、4つの特徴があります。

特徴1:大量の学習データが、流暢な会話を生成する

ChatGPT以降の生成AIは、チャット機能により流暢に会話ができるという特徴があります。利用者は自然な文章で入力することができるようになり、期待以上にスムーズな回答を得られるようになりました。しかし、生成AIは自信を持って誤った情報(ハルシネーション)を生成することがあり、流暢な文章のなかに誤情報が紛れると、一般の利用者には判断が難しく、事実に詳しい利用者には、なぜ誤情報が出たのか理解しにくいという特徴もあります。

ChatGPTは「次の単語を予測する」仕組みで動作しており、過去の会話の流れを考慮しながら確率的に言葉を選んでいます。大量のデータを学習しているため、誤情報が含まれていても、文章自体は違和感なく流暢に生成されます。

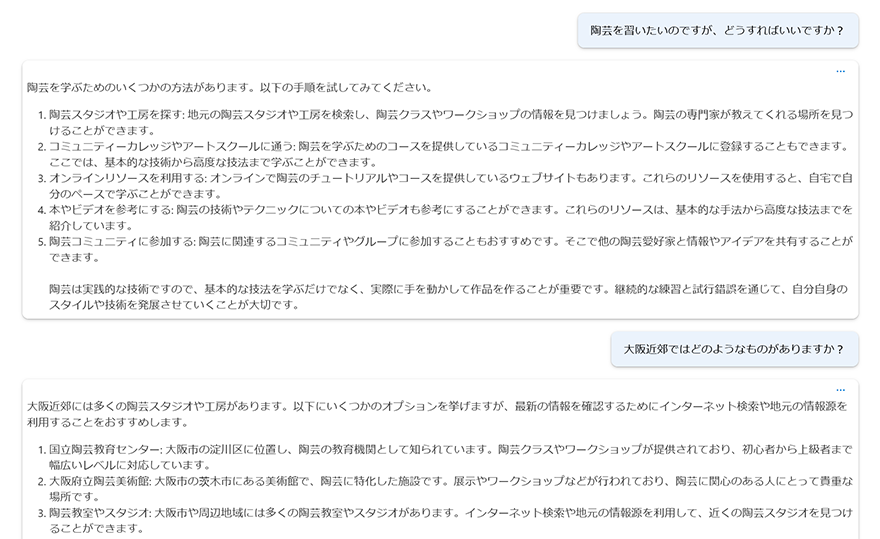

利用者の「大阪近郊ではどのようなものがありますか?」という質問に対し、前の会話の流れを考慮しながら、「大阪近郊には多くの陶芸スタジオや……」といった自然な回答を生成しています。

このとき生成AIは、「大阪近郊には」のあとに続く言葉を確率的に選んでいます。もしかすると、「多くの陶芸スタジオや……」という回答のほかにも、「次のような施設や……」や「著名な先生が開催されているセミナーが……」などの別の候補があったかもしれません。

-

※

ここで回答している陶芸教室は存在しません(Google検索の結果)

特徴2:事実であることを確認する機能は持っていない

生成AIが事実とは異なる情報を生成することを「ハルシネーション(幻覚)」と呼びます。生成AIは確率的に次の言葉を予測しているだけで、生成した情報が正しいかどうかを判断する機能がありません。最近のモデルでは、ハルシネーションを少しずつ抑制するようになってきていますが、完全に解消されたわけではありません。つまり、生成AIの出力情報をそのまま信じるのではなく、人が批判的に判断することが重要です。

下記の例では、生成AIがアメリカの紙幣に描かれた人物を回答していますが、紙幣や歴史に詳しい人であれば、回答に誤りがあるとすぐにわかります。正しくは「50ドル紙幣に描かれているのはユリシーズ・S・グラント大統領」です。しかし、知識がない人にはこれが誤情報であると判断しにくいのです。

そのため、Microsoft社が提供している検索エンジン「Bing」の生成AI検索では、情報の根拠を示し、利用者が正確かどうか判断しやすいよう工夫されています。

アメリカの紙幣には何が描かれていますか?

米国の紙幣には、アメリカ合衆国の歴史上の重要な人物が描かれています。例えば、1ドル紙幣には、ジョージ・ワシントン大統領、5ドル紙幣にはアブラハム・リンカーン大統領、10ドル紙幣にはアレクサンダー・ハミルトン、20ドル紙幣にはアンドリュー・ジャクソン大統領、50ドル紙幣にはウィリアム・マッカーシー大統領、100ドル紙幣にはベンジャミン・フランクリン大統領などが描かれています。

特徴3: 日本語と英語で回答が異なる

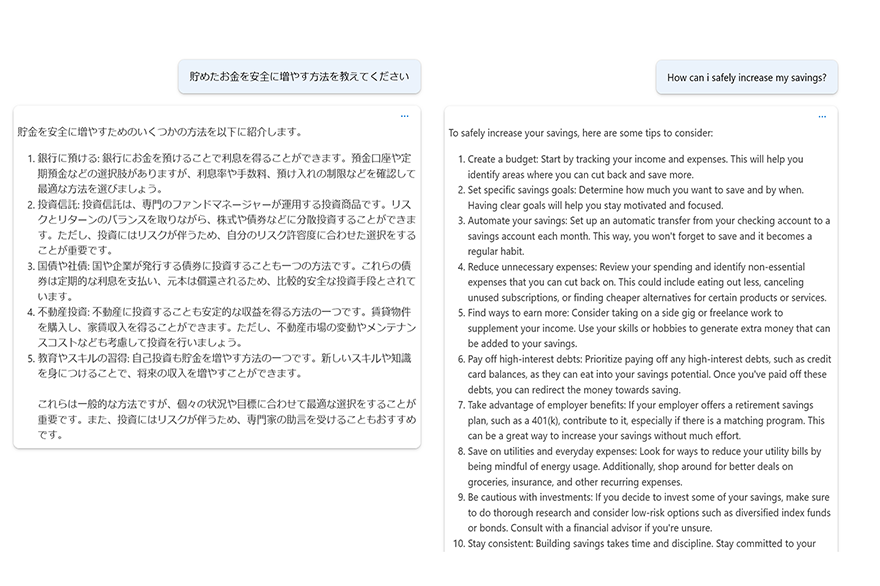

生成AIに同じ質問を日本語と英語ですると、異なる内容の回答が生成されることがあります。これは学習データの偏りが原因です。現在の言語モデルでは圧倒的に英語の文書が多いので、特に文化的な違いや、社会的な価値観の影響を受けるテーマでは、入力する言語によって見解が異なることがあります。

図4は、日本語と英語で「貯蓄を安全に増やす方法」を質問した事例です。日本語の回答では「定期貯金」「国債の購入」「投資信託」などの具体的な投資先を提示されましたが、英語の回答では「予算の作成」「貯蓄目標の設定」「ツールの利用」など、投資の方針を提示されました。

特徴4: 予測や分析が苦手

生成AIは言語モデルであるため、予測や分析などの高度な処理にはあまり適していません。一見、もっともらしい回答は出せますが、それは学習データ内の予測や分析レポートを参考にしている可能性が高く、ハルシネーションを生成してしまうこともあります。

予測や分析は、その結果を人が判断する必要があるため、言語モデルには不向きです。ただし、完成されたレポートの要約には向いているので、正しく活用することが大切です。

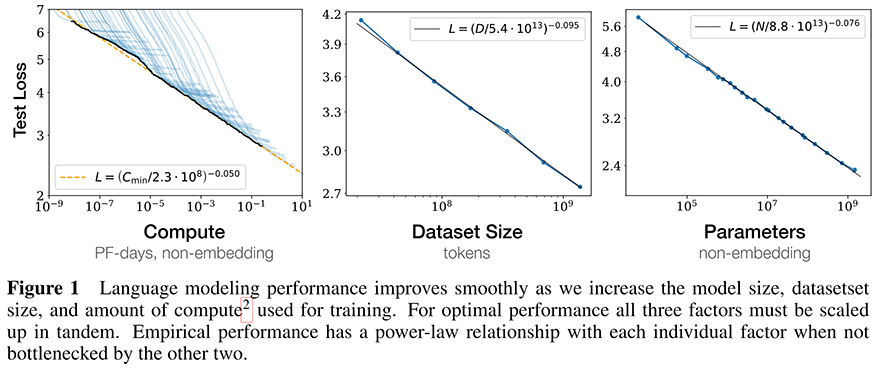

なぜ生成AIの仕組みがうまく働いているのか

では、なぜ生成AIの仕組みがうまく動いているのでしょうか。OpenAIとGoogleの論文によると、理由のひとつに「スケーリング則」と呼ばれる法則があります。スケーリング則とは、生成AIの性能が「パラメータ数」「学習データの量」「計算量」の3つの変数に左右されるというもので(正確にはTransformerと呼ばれる機械学習モデルの性質)、たくさんのデータでたくさん計算させるほど、生成AIの精度が上がるということを意味します。このスケーリング則に基づき、OpenAIはGPTシリーズのモデルサイズを拡大させてきました。

さらに論文によると、スケーリング則には限界がない可能性があり、理論上はこの3つの変数を上げ続けることで、生成AIの性能を無限に向上させられる可能性があるとされています。

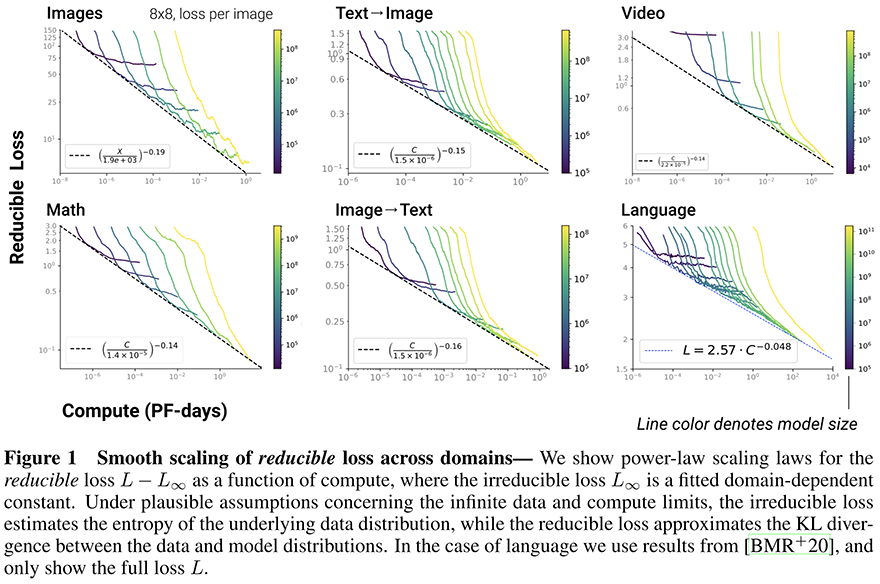

もうひとつの重要な点は、スケーリング則が言語モデルだけでなく、画像・動画・数学・マルチモーダル(複数の情報を組み合わせる技術)などにも応用できる ことです。この仮説を確かめるために、OpenAIはGPT-4からマルチモーダルの開発を進めています。

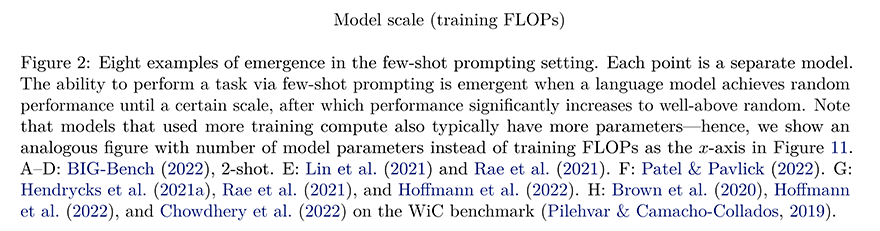

一方、Googleの研究によると、生成AIのモデルをスケーリング則に従って大きくしていくと、ある段階で性能が急に向上すること(創発現象)がわかっています。この現象がなぜ起こるのかは、まだ研究中ですが、一部の研究者は「相転移(フェーズトランジション)」と呼ばれる物理学の現象に似ているのではないかと考えられています。

さらに、生成AIの性能が飛躍的に向上し続けることで、やがてシンギュラリティ(技術的特異点)に到達する可能性も議論されています。シンギュラリティとは、AIが人間の知能を超え、自己進化を続ける転換点のことを指し、その影響は社会全体に及ぶと考えられています。特に、スケーリング則による性能向上が続けば、生成AIが予測を超えるスピードで発展し、人間の役割や社会の在り方が大きく変わる未来が訪れるかもしれません。

生成AIは必ずしも正しいとは限らない!

今回はChatGPTの登場で広まった生成AIの仕組みや特徴について解説しました。技術に詳しくない人のなかには、生成AIがネット検索のようにどんな質問にも正確に答えられると思っている人もいます。しかし、技術者の視点では、「生成AIはそれらしい答えを確率的につくり出すだけで、必ずしも正しいとは限らない」ツールであり、活用には注意が必要という認識です。効果的に使うためにも、生成AIの特徴や限界を誤解せず、この違いをしっかりと理解しておくのが重要です。

筆者紹介

林 淑隆

R&D本部 言語処理技術部所属。言語処理技術や情報検索技術に関する研究開発、技術調査等に従事。大規模言語モデル(生成AI)自体の制御・運用に関する研究開発に取り組む。